Вже не вперше компанія Facebook потрапляє у подібні скандали, однак цього разу, видається, ми будемо мати набагато більше відкритої інформації, щоб зрозуміти, що ж трапилося і набагато радикальніші заяви за результатами слухань. Однак, деякі скептики все частіше заявляють – нам потрібно усвідомити, що рішення компанії базуються насамперед на її бізнес-моделі, яка так чи інакше конфліктує з інтересами користувачів. Більше того, на засіданні Сенату США у вівторок 10 квітня, Цукерберг сам заявив, що змушений конкурувати із такими ІТ гігантами як Google, Twitter та Apple.

Втім, незважаючи на результати обговорень, що зачеплять більш фундаментальні питання безпеки даних користувачів, ця криза відкрила цікавий алгоритм поширення та обмеження інформації у Facebook, в залежності від вподобань користувача. Тож чи мають здатність соціальні мережі фільтрувати контент, що набільше відповідає вашим політичним вподобанням, одночасно обмежуючи новини з опозиційного "політичного табору"? Останні дослідження демонструють, що такий алгоритм має місце, хоч його наслідки не є такими значними, як може здаватися на перший погляд.

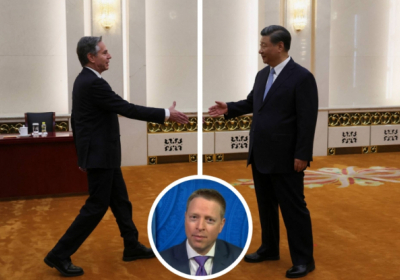

Фото: Reuters / Stephen Lam

Не секрет, що сьогодні ми усі живемо в "інформаційних бульбашках", що визначені нашим колом спілкування, освітою та джерелами отримання і поширення інформації. Однак, якщо ще півстоліття тому наповнення цієї "бульбашки" інформацією вимагало неабияких навиків та затрат часу і навіть ресурсів, то сьогодні ми швидше за все змушені фільтрувати інформацію, відсікаючи те, що нам не потрібно – так звані "інформаційні шуми". Розуміючи скільки часу можна витратити даремно пробираючись через "джунглі" непотрібної інформації, ІТ компанії розробили алгоритми персоналізації інтернету.

Таким чином, даючи запит у пошукових мережах таких як Google чи Yahoo, ми отримуємо результати, що автоматично корегуються в залежності від того, що пошуковий сервіс знає про нас. При цьому, багато данних ми надаємо добровільно, заради тієї ж персоналізації. І здебільшого – це дійсно зручний інструмент, що економить наші нерви та час. Скажімо, вбиваючи у полі пошуку фразу "купити замок", більшість із нас розраховує отримати вибірку адрес, де можна купити замок до дверей, і лише небагато – вибірку родових замків середини 18 століття. З іншого боку, до значних незручностей може призвести локалізація, коли різні онлайн-магазини можуть показувати різну ціну на товари, в залежності від країни вашого перебування.

Гортаючи стрічку новин, нам може здатися, що ми бачимо потік постів чи репостів наших друзів та підписок. Однак це враження є лише частково правильним. Facebook використовує алгоритми, які фільтрують і тегують усі повідомлення, перш ніж ми їх побачимо. І ці алгоритми постійно змінюються! Якщо спочатку ми мали справу із кількістю "вподобайок" та кліків, то тепер контент оцінюється на предмет найбільшої відповідності нашому профілю, інтересам та інформації, що ми поширюємо. І лише зовсім недавно з’явилася опція показувати ті чи інші новини пріоритетно у порявнянні з іншою інформацією. Проте нам до сих пір невідомо і Facebook не відкриває цю інформацію, які саме теги отримує скажімо ваше свіже сімейне фото, який алгоритм його подальшого поширення і яку ще додаткову інформацію окрім місця і часу поширення фото отримує і зберігає мережа.

Але яке це все має відношення до фільтрування політично-заангажованої інформації? Так чи інакше, фільтрування і тегування створюють обмеження для представників різних політичних таборів – їхні "інформаційні бульбашки" можуть просто ніколи не перетнутися. З часом, це призводить до політичної поляризації, оскільки люди не підпадають під параметри тих тем та ідей, що поширюються опозиційним політичним табором. Так, з одного боку менше стресів і провокацій, але з іншого це свторює паралельні світи, які не розуміють один одного.

Водночас, визначити політичні преференції соціальній мережі не так складно. Найперше, ми часто самі про це зазначаємо у своєму профілі в Facebook, більше того дехто навіть додає свій зв’язок із конкретною партійною організацією. Тоді, аналітики мережі мають можливість проіндексувати ваш вибір у певному діапазоні від крайніх ліберальних (+2) до крайніх консервативних поглядів (-2) і зібрати масив інформації по чітко ідентифікованих позиціях. А далі, розпочинається таргетування тієї чи іншої новини в залежності від "політичного узгодження" цієї новини із користувачами, що опублікували новину в себе на сторінці.

Як наслідок отримаємо середній політичний індекс будь-якої новини, чи навіть медіа-ресурсу загалом. Найбільш відповідна вашим поглядам новина буде мати більшу ймовірність потрапити вам на очі. Уявімо лише, що майже усі наші дії у мережі так чи інакше призводять до майбутнього потрапляння в нашу стрічку новин відповідної таргетованої інформації. Цим і скористалися аналітики Cambridge Analytica, формуючи чітко таргетовану політичну рекламу і поширюючи її через найбільш зручні для її поширення канали. Відповідно, кожен користувач отримає своє, найбільш бажане та однобоке. Так, в нас все одно залишається право вибору, але чи враховуємо ми, на основі яких данних ми робимо цей вибір?

/cdn.vox-cdn.com/uploads/chorus_image/image/57135749/607814904.0.jpg)

Александер Нікс. Фото: Bryan Bedder / Getty Images

Славнозвісні "армії ботів" можуть транслювати цілком тверезі думки, для залучення якомога більшої кількості користувачів і вже тоді формувати контент під їхній запит, але із чіткою метою - сприяти пропаганді та маніпуляціям на користь своїх замовників. Не секрет, що однією із найбільш активних в цьому напрямку виявилася російська влада та розвинена інфраструктура інтернет-ботів, що фінансуються Кремлем. За деякими даними, росіяни активно втручалися у останні виборчі кампанії США, Німеччини, Італії, Австрії, Чехії, тощо та навіть у референдумі щодо Brexit. Марк Цукерберг сам зазначає, що його компанія постійно перебуває у "гонці озброєнь" з Росією через фейкові акаунти, які намагаються обдурити систему розпізнавання Facebook та впливати на місцеві вибори по всьому світу.

Досліджуючи поширення таких новин на прикладі 10 мільйонів американських користувачів Facebook, Ітан Бакші, Соломон Мессінг та Лада Адамік прийшли до висновку, що насправді алгоритми мережі здатні створити ефект поширення інформації одним політичним табором, хоча й зазначили, що першість у відборі того, що читати все ж поки належить саме користувачеві. Тому наша медіа-обізнаність та інформаційна гігієна повинні бути в активному користуванні кожного разу, коли ми вподобуємо чужу новину чи репостимо повідомлення.

Пам’ятаймо, що однобоке трактування подій, спрощення пояснень та надмірне емоційне наповнення є прямим свідченням, що наша інформаційна "бульбашка" зіткнулася із каналом поширення маніпулятивної політичної інформації. Важливо виходити за рамки односторонньго бачення, стикатися із тими думками, які ви не підтримуєте, але з якими можна раціонально вести спір. Звісно, диплом політолога може допомогти вам бачити варіативність трактувань та розуміти політичні механізми, що стоять за подіями, але навіть якщо у вас немає для цього достатньо часу чи бажання, участь у місцевому дебатному клубі, чи обговорення політики за партією шахів, можуть виявитися доброю вправою для зустрічі з іншою точкою зору.