Розумні гаджети, розумні будинки, в яких побутова техніка спілкується між собою без втручання господарів, все це вже є сьогодні. Це зручно, але сама техніка дає зрозуміти, що не завжди безпечно. Вже не вперше фіксували випадки, коли запрограмовані системи вели себе неконтрольовано: в Китаї робот напав на людину, в Австрії розумний пилосос вчинив самогубство, а нещодавно в США робот, який патрулював торговий центр, в’їхав у фонтан і втопився.

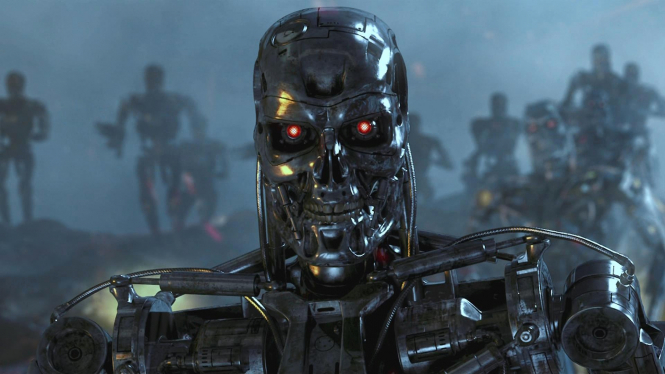

Повстання штучного інтелекту за сценарієм Маска

Проте побоювання викликають не пилососи-самогубці, хоч це також становить загрозу життю людини. Глава компаній Tesla та SpaceX Ілон Маск нещодавно попередив, що роботи можуть оголосити війну представникам нашого виду на інформаційному рівні. Початком цього, як зазначає Маск, може стати поширення ШІ фейкових новин та прес-релізів з метою маніпулювання людством. "Перо сильніше меча", - наголосив Маск. Таким чином, на його думку, все може дійти і до військового конфлікту між людьми. Як один з варіантів для уникнення такого розвитку подій, Маск пропонує запровадження прозорості та регулювання технологій на державному рівні.

До слова, інформаційне агентство Associated Press вже не перший рік користується послугами штучного інтелекту для написання новин, а два роки тому в компанії "Яндекс" заявили про плани створити інформагентство, в якому працюватимуть виключно роботи. Хоч на сьогодні поширення фейкових новин і без втручання машин не дивина, маніпуляції за схемою "людина-людина", людей менше насторожують, ніж "машина-людина".

На противагу заявам Маска, засновник соцмережі Facebook Марк Цукерберг дає позитивніші прогнози результатів співпраці з ШІ. Поширення подібних висловів Цукерберг назвав безвідповідальними і нагадав,що будь-які технології можна використовувати як з добрими намірами, так і зі злими. Зазначимо, компанія у грудні оголосила про посилення заходів протидії новинам, які містять фейки та містифікації. До Facebook планував також долучитись і Twitter. З одного боку, поглиблення роботи ЗМІ в соцмережах дозволяє краще контролювати ситуацію з неправдивою інформацією, з іншого - зосередження контролю над інформаційним полем "в одних руках". Як приклад згадаймо минулорічний скандал щодо перемоги Дональда Трампа на виборах США, в якому фігурувала компанія Facebook.

Також не згодний з заявами Ілона Маска і генеральний директор Toyota Institute (відділ компанії Toyota, який займається проектами, пов'язаними зі взаємодією з ШІ) Гіл Пратт. Він переконаний, що той страх, який ми чуємо від широкого кола людей, з Маском включно, може бути обумовлений не більше, ніж тими антиутопічними описами світу, які нам пропонує наукова фантастика.

"Наші нинішні системи глибинного навчання хороші у виконанні поставлених перед ними завдань лише настільки, наскільки ми їх самі створили. Але насправді вони досить вузькоспеціалізовані і крихітні за своїми масштабами. Тому я вважаю важливим кожен раз в контексті цієї теми згадувати і те, наскільки вони хороші, і те, наскільки вони насправді малоефективні. А також те, як далекі ми від того моменту, коли ці системи зможуть почати представляти ту загрозу, про яку говорить Ілон Маск і інші", - розповів Пратт в інтерв'ю виданню TechCrunch.

Проблема безробіття, як виклик для людства

Проте справа не лише у фейках. Люди готові довірити розумним машинам не тільки написання новин, а й власне здоров’я. В деяких лікарнях Японії, до прикладу, ШІ встановлює діагнози пацієнтам, з якими не можуть впоратись звичайні лікарі.

Інформаційна війна – не єдине, на що звертав увагу Маск. Минулого року він попередив, що через розвиток технологій на людство чекає масове безробіття. Роботизація багатьох сфер вже призводить до зникнення деяких професій. Найпершими в цьому списку листоноші і доставщики товарів (компанія Amazon успішно протестувала доставку посилок дронами, а в Китаї доставляють піцу безпілотниками), касири (в деяких українських супермаркетах вже можна розрахуватися на касі самообслуговування), водії (безпілотні таксі вже не новина, також в Естонії нещодавно запустили безпілотні маршрутки, причому безкоштовні), перекладачі, турагенти та журналісти (досвід Associated Press). Хоч в останньому випадку можна й посперечатись, що журналістика це не лише написання новин, однак роботи давно освоїли вже написання статей і з аналітикою в них все добре. А щодо креативності, як переконані експерти – з цим у ШІ теж проблем немає: на основі вже існуючих творів мистецтва робот і поему написати може, і картину намалювати (людська творчість будується здебільшого за подібним принципом).

Вчені з Інституту майбутнього людства Оксфордського університету порахували, що штучний інтелект перевершить можливості людини в перекладі мов до 2024 року, написання есе після закінчення середньої школи - до 2026-го, повністю замінить водіїв вантажівок – у 2027-му. Професії продавців роздрібних магазинів зникнуть в 2031 році, письменники, які спеціалізуються на белетристиці, - до 2049-го. Хірурги, за прогнозами вчених, стануть непотрібними до 2053 року.

На зміну цим професіям, запевняють експерти, з’являться нові, такі як біохакери (експериментатори з можливостями біологічного тіла людини, доповнюючи його електронними імплантантами), дизайнери, які створюватимуть світ віртуальної реальності (від формування соціальних груп, до розваг). Зокрема будуть люди, відповідальні за сервісне обслуговування вищезгаданих, системи безпеки та контролюватимуть інформаційні технології. Такий розвиток подій можливий, якщо люди будуть гнучкішими до змін, що привносить в наше життя роботизація. Плюс місця для ліні і небажання освоювати нові знання в такому сценарії немає. В інакшому випадку клас безробітних тільки збільшуватиметься.

Провідний лектор Академії футурології Альберт Фельдман називає такий клас "класом безкорисних" і, на його думку, вони своїм бунтом можуть породити одну з загроз майбутнього. Серед небезпек Фельдман також виокремлює втрату контролю над штучним інтелектом, повстання роботів, деурбанізацію, маніпуляції соціальним та особистим життям людини. І, звичайно ж, зниження рівня інтелекту, а також погіршення фізичного здоров’я людей. В такому випадку, розвиток сюжету мультфільму "ВАЛЛ-І" цілком можливий в реальному світі.

Чи насправді все настільки страшно?

В погоні за розвитком технологій людство опинилось в черговій крайності. І тепер, схоже, пробує шукати баланс. Нещодавно компанія Ford оприлюднила звіт по щорічних дослідженнях світових трендів. Однією з тенденцій сьогодення виявися якраз зворотній бік технологічного прогресу: 77% опитаних по всьому світу згодні з твердженням "Повальне захоплення технологіями призвело до зростання ожиріння серед людей". Зокрема те, що використання технологій призводить до порушення сну відзначають 78% жінок і 69% чоловіків, що гаджети роблять людей менш розумними вважають 47% опитаних, і менш ввічливими (63%). Однак, скарги і спостереження це одне, а обмеження і заходи безпеки в реальному житті – дещо інше.

Чому один бот вигадав власну мову, а інший став расистом?

Ріст страху стосовно роботів і штучного інтелекту підживлюють також засоби масової інформації. В кінці липня мережу розривали заголовки в стилі "Facebook "убив" штучний інтелект, який придумав власну мову". Насправді все виявилось не настільки "смертельно". Компанія тестувала чат-ботів – діалогових агентів для ведення переговорів. В ході експерименту боти вигадали власну мову, що і насторожило мережу. Проте дослідження результатів тесту показало, що причиною виникнення "химерної" мови виявилась помилка експериментаторів, які не задали ботам умов спілкуватися згідно з правилами англійської мови. Тому діалогові агенти почали спрощувати вже задані слова для досягнення ефективного результату, а їхня мова виявилась примітивною. Цей процес не надто відрізняється від того, як люди самі вигадують скорочення в ході спілкування. Але спростування новині про "нову мову штучного інтелекту", принаймні в українському медіа просторі, мало хто написав. Так і залишили.

Повернемось до вищезгаданого китайського робота, який травмував людину: машина вийшла з-під контролю і почала корпусом трощити скляну вітрину, в результаті представник персоналу отримав травму ноги. Однак виробник тоді заявив, що в інциденті винен оператор, який переплутав кнопки, а система убезпечення від зіткнень не спрацювала, оскільки у Little Chubby була відкрита панель управління.

Ще один приклад - ШІ-алгоритм Тей (Tay), який тестувала компанія Microsoft. Менш, ніж за день в мікроблозі Twitter бот перетворився в справжнього расиста, почав твітити нетолерантні висловлювання, через що його вимушені були вимкнути. Як виявилось, алгоритм був запрограмований на "навчання" і "дзеркальну поведінку" і, так як бот потрапив під вплив расистських та інших образливих лексичних словоформ в соцмережі, він показав невтішні результати.

Як бачимо ключовою ланкою в подібних інцидентах є людина. І, в такому випадку, заголовки повинні бути типу "Працівник переплутав кнопки, через що робот травмував людину", але кого ж цим здивуєш, що людина щось наплутала. Цікавіше персоніфікувати техніку і створити людству чергового ворога, якого потрібно боятись. Те саме стосується і штучного інтелекту.

Як пояснює виконавчий директор і старший науковий співробітник Центру вивчення майбутнього інтелекту Стівен Кейв, причини даного страху цілком зрозумілі: людство історично звеличувало наявність інтелекту, що часто призводило до виправдання багатьох жахливих і варварських вчинків, а результати тестів на IQ були причиною для виокремлення еліти суспільства, якій належали всі привілеї. Кейв припустив, що якщо ми приймаємо ідею про те, що більш розумні можуть колонізувати менш розумних і використовувати їх як рабів, тоді для нас буде природним рішенням стати рабами роботів, багато в чому раціональніших, ніж людина, тоді тут немає чого боятись. Виходить, що перед людством стоїть страх, навіяний попереднім історичним досвідом.